炒作机器的算法如何影响我们做选择?

本书摘编自《炒作机器》,作者:[美]锡南·阿拉尔著,36氪经授权发布。

在数字社交网络、机器智能和智能手机这三个领域里的设计和开发共同决定了炒作机器将如何构建我们这个世界。

在很大程度上,数字社交网络构建了当今社会的信息流;通过好友推荐和在馈送算法引导下的网络信息流动,机器智能引领了当今数字社交网络的演化;而智能手机为炒作机器的运作创造了一个“永远在线”的环境。

从我们的行为与表达的观点中,智能手机和数字社交网络每时每刻都在搜集各种数据,然后将这些数据输入机器智能中,机器智能构建了我们获取信息的渠道,限制了我们可以接触的观点和信念。数字社交网络、机器智能和智能手机的三位一体已经改变了我们生产与消费信息的方式,改变了我们的日常行为以及获取信息的方式,也改变了炒作机器对我们产生影响的方式。

理解信息处理机器总共分几步?

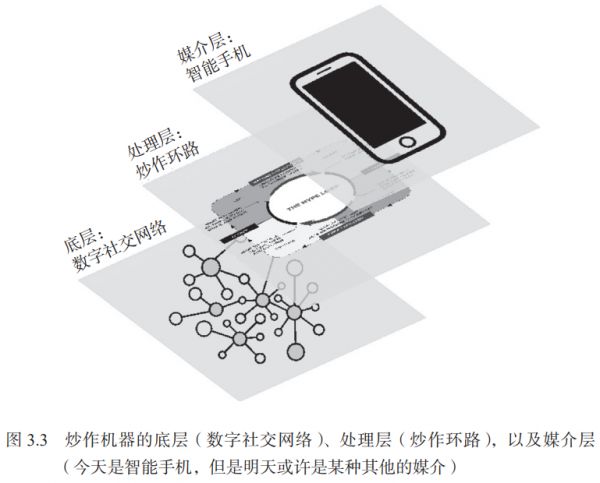

要想真正理解这样一台信息处理机器,我们必须首先了解它的三个基本组成部分:底层、处理层以及媒介层。

底层指的是数字社交网络,这个网络构建起了我们进行互动的方式;处理层又被称作“炒作环路”,它通过机器智能和人类智能的互动来控制信息在底层的流动;最后是媒介层,也就是智能手机(至少目前是智能手机),它是主要的输入与输出设备,大多数人都是通过智能手机向炒作机器提供或接收有关信息的。任何我们可以用来进行解释的理论或分析,比如,为什么虚假新闻在网上传播的速度会比真相更快,或者为什么炒作机器以其目前的形式会破坏“群体智慧”,都需要我们对这三个组成部分有基本的了解(见图 3.3)。

这里所谓的“底层”实际上是网络本身,而底层就是炒作机器的核心。这种网络是一种不断演化的、数量达到了人口规模的各种链接的集合,它通过脸书、推特、领英以及其他社交网站把我们连接在一起。底层塑造了炒作机器当下的形态,并且在很大程度上构建了能够决定“谁能知道什么,以及在什么时候知道”的基础架构。与炒作机器连接的网络结构决定了信息流动的方式,所以只要了解了这些结构以及它们是如何演化的,那么无论是面对政治两极分化的兴起、社会运动发展的势头,还是面对虚假新闻的传播或定位广告的成功,我们都可以从中获得关于这个社会运作方式的洞见。

具体规范网络的演化并管理信息在网络上的流动的“处理层”就是我所说的炒作环路。

正是机器智能和人类智能的循环互动决定了我们会关注什么,以及信息和知识如何在世界各地传播。推动人和机器互动的是机器智能的兴起,以及我们已经拥有的在人口规模上搜集有关人类思想、行为和观点的数据的能力。机器智能吸收了我们的思想、行为和观点,反过来又策划了我们在信息流中看到的那些故事、在Instagram上看到的图片、在领英上被推荐的同事和在Tinder上被推荐的约会对象,以及我们在这些内容旁看到的广告。随后,我们就会消费这些信息并在这些信息的基础上进行决策。我们会点击一些被推送给我们的链接和图片,然后放弃其他的链接和图片;我们会对一些帖子进行评论或点赞,但同时会完全无视其他帖子和内容;我们甚至会在投票站和大型购物中心依照我们在网上看到的内容改变我们的线下行为。

炒作机器会在一旁观察我们的决策过程,了解我们喜欢什么,我们会喜欢谁,以及我们是如何进行思考的。这样,等到下一次在同样的场合,它在调整后给出的建议就会更符合我们的心意。这种人类和机器循环互动的过程,也就是被我称作炒作环路的处理层。在它左右我们决策的同时,我们实际上也对它产生了影响。但是这种循环互动的结果是非常真实的,你会决定买下它推荐的产品、投票给网上曾经提到过的那个人,你还会跟随其他人出现在市内的广场上进行抗议。当然,有时候事情还会像发生在巴格达的塔利尔广场上的那些事情一样具有戏剧性的效果。

媒介层指的是我们与炒作机器进行互动时使用的输入与输出设备。今天,媒介层主要指的是智能手机,但明天,它或许会是AR或者VR头盔、数字隐形眼镜、虚拟人、室内音响设备或上述这些设备的某种组合。无论实际采用的是什么设备,媒介层都是极其重要的一环,因为它决定了炒作机器会在什么样的背景下了解我们,并随后影响我们。

你和谁联系不是你决定的

我们在网上会和谁建立联系,这在很大程度上是由一系列的好友推荐算法推动的,这种算法几乎在炒作机器的所有平台上都可以找到,无论是脸书的好友推荐算法,还是领英的PYMK算法以及其他各种各样的算法,所有算法都会向我们建议应该和谁约会、和谁做生意或者和谁交往。

拉尔斯·巴克斯托姆在成为脸书的工程副总裁之前,具体负责脸书的PYMK算法。正如他在2010年指出的那样,“在脸书上,大多数互加好友的行为”都是由脸书的好友推荐算法推动的。尽管PYMK算法是领英公司在2006年发明的,但现在,在炒作机器上把陌生人相互联系在一起的机器智能几乎无所不在。

虽然这些算法的细节属于技术专利,但毫无疑问的是,我们都知道它们会利用我们的朋友和他们的朋友的信息,以及关于我们在哪里工作、去哪里上学等这样一些信息来向我们推荐新的联系人。还有一种普遍的看法认为,炒作机器会利用不在其平台上的人的电子邮件和电话号码来增强它们对真实的、潜在的人类社交网络的理解。

2014年,脸书申请了一项专利,这项新的技术可以通过嗅探网络数据包来推断两部手机是否在同一时间出现在了同一地点,然后再以此为依据来进行好友推荐。这项专利还描述了脸书如何通过比较手机的加速度计和陀螺仪的数据来推断两个人正面对面行走,还是正朝同方向一起行走。2015年,脸书又申请了一项专利,新的专利可以通过用户拍摄照片的相机镜头上的灰尘颗粒,推断出两个人上传的照片是否出自同一台相机。我们知道,PYMK算法中的“链接预测算法”需要整个系统向其提供大量的数据,而数据的采集过程对隐私造成的影响很可能是一件非常麻烦的事情,但是在炒作机器的内部,这一部分机器智能产生的更加系统化的结果或许会带来更加广泛的影响,那就是PYMK算法会更倾向于促成“三元闭包”。

算法如何塑造我们的思维方式?

炒作机器的智能程序不仅仅通过推荐好友来塑造社交图谱,还通过推荐我们消费的内容,即通过推荐新闻、图片、视频、故事以及广告来塑造我们的思维方式。毫不夸张地说,馈送算法在很大程度上决定了我们可以知道什么以及在什么时候知道。理解这些算法的设计可以帮助我们理解它们可能带来的后果。尽管不同的平台有不同的馈送算法,但所有的馈送算法在设计上都非常相似(虽然有些平台,比如推特,现在依然允许我们选择不参与算法的内容管理)。

当内容的供应超过了我们消费内容所需的认知能力时,主动推送的需求就自然而然地出现了。刚开始的时候,炒作机器用倒序的方式来显示内容就足够了,但是随着社交媒体上内容的数量逐渐超过了我们认知的容量,炒作机器不得不开始为我们安排这些内容的优先级。虽然这样的优先排序可以帮助我们发现与我们最密切相关的东西,但与此同时,这使得炒作机器有了巨大的权力来决定我们可以看到哪些信息。

信息流算法会根据内容的相关性对其进行排序。首先,对于每一篇内容,信息流算法都会给出一个对每个人来说都独一无二的“相关性评分”。随后,在推送给我们的新闻中,这些内容会被按照相关性评分依次递减的顺序进行排列。这个相关性评分是由一些预测模型给出的,而这些模型会去了解是什么驱使着我们与某一段内容进行互动。

在这里,互动是通过我们在处理这些内容的过程中表现出来的数十种行为来定义的。例如,我们可以点赞、点击、分享、花时间仔细阅读或观看、针对具体的内容撰写简短的评论等。预测模型会基于是谁上传了相关的内容、内容涉及了哪些领域或行业、其中是否包含了图片或视频、视频中有什么样的内容、是否是最新的内容,以及我们有多少朋友曾经点赞或分享了这些内容等,来预测我们是否也会参与这些内容互动。在根据数十种不同的参与度衡量标准得出了我们会参与互动的概率后,所有这些参与互动的概率都会被汇总成唯一的相关性评分。一旦每一篇内容都有了一个相关性评分(每一次当你打开信息流服务时,脸书的算法就会针对2000篇不同的内容为你计算出所有的相关性评分),它们就会被按照相关性评分逐次降低的顺序进行排列并显示在你的信息流服务中。

脸书在2006年推出信息流服务的时候,其主要目的还是向用户提供朋友的资料、照片以及状态的更新信息。在2009年点赞按钮被发明出来之前,信息流是根据有关内容发布的时间以及我们有多少个朋友曾经提到过某个帖子等因素来进行排序的。当然,这项服务的推出(站在脸书的角度)从根本上还是为了最大限度地提高用户的留存率和他们在网站上滞留的时间。点赞按钮的推出把信息流中的每一条新闻的价值和某种衡量“流行度”的标准捆绑在了一起,从而使优化的重点转向了那些具有更高的流行度的项目。

点赞按钮成了某种衡量流行度的公共标准,这一事实意味着出版商和普通的用户可以通过调整自己的内容来获取更多的点赞,而这又可以让内容赢得更高的“收视率”。很多顾问公司声称自己可以“玩弄”算法,比如通过提高帖子的流行度使帖子在网上火起来,而现在这已经成了司空见惯的事。

但是,如果你认为信息流只考虑了点赞、评论和分享这些因素,那就过于简单了。脸书的工程师们很早就意识到,这些衡量指标并没有完全捕捉到人们想要从信息流中得到的东西,因此,他们决定通过直接提问来衡量用户的满意度。刚开始的时候,整个项目还只是一个针对1000个客户的小型“焦点小组”,项目人员的办公室位于田纳西州的诺克斯维尔,而诺克斯维尔只不过是一个试点项目随意选取的“具有某些历史意义”的地址而已。但这个项目很快就成长为一个全球性的“信息推送质量论坛”,这已经相当于一个针对脸书的信息流服务而设立的“尼尔森评级小组”了。

具体来讲,世界各地的用户可以就他们的信息流的内容和质量,有偿地参与评估并回答一系列的问题。通过将定量和定性的指标结合起来,脸书了解到,那些用户花了很多时间去阅读但并没有点赞的帖子对他们来讲依然是有价值的。比较典型的是,用户在看到关于他们自己朋友和家人的悲惨消息时,他们当然不会点赞(为了应对这一类情形,有关愤怒、悲伤和惊讶的反应后来也被添加了进来)。在上述实验中,脸书还设置了一个控制组,用户在这个组中是无法看到任何新的设计变更的,这样他们就能够具体评估哪些做法是有用的,而哪些做法根本没有效果。

当炒作机器通过感知并向人类推荐好友和内容的方式来架构我们人类的现实时,我们会通过消费炒作机器给出的建议,并按照这些建议采取行动的方式使整个过程都受到人类的主观能动性的影响。在炒作环路中,与人类能动性有关的“消费和行动”环路是我们将建议转变为行动,并将由此而产生的行为、反应以及观点反馈给炒作机器的过程。

书名:《炒作机器:社交时代的群体盲区》作者:[美]锡南·阿拉尔(Sinan Aral),出版社:中信出版集团

作者简介

[美]锡南·阿拉尔

l 数据科学家,麻省理工学院社会分析实验室负责人。他在社交网络与传播领域探索了20多年,专注于研究资讯如何透过社交媒体扩散,影响市场与消费者行为。

l 企业家、投资人。他曾联合创办风险投资基金Manifest Capital,并与脸书、推特、微软等企业密切合作。

l 他还是英国艾伦·图灵数据科学研究所、英国国家数据科学研究所顾问委员会的成员。

相关推荐

清华大学胡钰教授:当社交媒体变成“炒作机器”

AI沦为炒作的工具?

数字的反乌托邦:算法是如何惩罚穷人的?

理性看待算法治理:从“算法选择”到“选择算法”

纠正算法的偏见,究竟是要与机器斗还是与人斗?

人工智能的“死亡算法”:机器帮助人类理解死亡

极端实验:推荐算法如何探寻我们的兴趣边界?

AI 已具备人格?给有关人工智能的炒作泼泼冷水(上)

今天我们被算法“控制”了吗

从“机器儿童”到“机器学习”:“学习”的概念是如何变化的?

网址: 炒作机器的算法如何影响我们做选择? http://m.xishuta.com/newsview64858.html