人性善恶,决定科技善恶

编者按:本文来自微信公众号“笔记侠”(ID:Notesman),作者 风潇潇,36氪经授权转载。

2019年,移动互联网不像前两年,没有带来太大惊喜,但有两款应用一夜之间刷爆朋友圈。

一款是某知名换脸应用。仅需上传一张照片,“推荐-添加面孔-替换”三步走,你就可以成为经典影片中的影帝/影后,整个过程用时不到10秒。

另一个是一键脱衣的APP。只需要一张照片,即可借助神经网络技术,一键“脱掉”女性的衣服。无需任何技术支持,一键即获取。

(图片来源网络,侵删)

两款APP刷爆各大社交平台后,引发了巨大的争议。首先是换脸APP用户发现自己的照片在不知情的情况下被用在别的互联网平台上。而后很快,同类型APP就陷入了侵权的纷争当中。

爆火的AI应用迅速被下架,速成走向速朽。引人反思的主要在两点:

一是企业方利用AI(人工智能)和用户数据的边界在哪里?应该如何界定?监管应该如何明令禁止?

二是企业方应该担负起什么样的社会责任?而不是在灰色地带,利用公众信任打擦边球?

简单说,就是AI(人工智能)的边界在哪里?企业又应该如何应对?

一、大辩论:人工智能是扬善还是作恶?

AI(人工智能)究竟是扬善,还是作恶?

一方面,AI(人工智能)造成了像我们文章开头提到的隐私泄露、非法使用个人信息等等问题。

与此同时,“阿尔法狗”事件之后,可以说,人工智能完全颠覆了之前人们对AI的认知。像阿尔法狗那么聪明而且可以24小时不间断地学习,不间断地工作,人类有可能打败它吗?科技界的各路大佬,也表达了对AI的担忧甚至恐惧。

斯蒂芬·霍金曾说,人工智能的崛起可能是人类文明的终结。

埃隆·马斯克也说过,人工智能是人类生存最大的威胁,研究人工智能如同在召唤魔鬼。

但事实上,现在我们每天的生活已经无法离开AI了——家中的小爱音响,车中的智能导航助手,应用里的智能客服,会打电话的银行客服,国际旅行时的随身翻译……AI已经悄悄地渗透进了我们的生活。

我们还是以AI人脸识别为例子:

人脸识别,不仅方便我们的移动支付,也可以在我们提着菜篮子回小区的时候,帮我们直接刷脸开门,还可以帮助警察抓捕疑犯或者寻找失踪的小孩。

人脸识别的人工智能甚至还可以用到动物上,比如猪脸识别。中国人消费了世界上最大规模的猪肉,而猪的养殖有一个很大的问题在于猪瘟。

AI养猪,一定程度上能尽早地识别患病的猪,及时进行治疗或隔离,能够最大程度地减小疫病对整个养猪场的影响。

不置可否,这项科技的发明不仅在重塑商业形态,也给我们带来了诸多的便利,促进社会的进步。但是也出现了我们开头提到的隐私泄露、商用侵权的严重问题。

AI掌握在人的手中,科技是扬善还是作恶,事实上都取决于人,甚至能放大人性中黑暗或善的一面。

企业在利用AI的时候,最终结果所呈现的“向善”或“作恶”,其实正映照出企业的“技术价值观”,反映出企业所相信的,技术能为人带来些什么。

二、AI是人类的一面镜子

人工智能,Artificial Intelligence,其实本意是“人造出来的智能”,只能通过学习人的行为和既有的历史数据,形成智能。

也就是说,只要没有技术性错误,AI最后导向的结果,背后所有的因果关系,都源于人类社会,最终导向它自己的“理解”。

正因为AI是对“智能”的再造,就像人类智能的模仿者,完全基于对人类既有的行为形成的历史数据,进行学习,所以AI就成为一面镜子,让人类能够更清楚地看清去自我,反思什么才是更加美好,未来世界应该用AI来做什么。

绝对的技术,带来绝对的滥用?

思想家阿克顿说:绝对权力导致绝对腐败。

放在现在,绝对的技术,也会导致绝对的滥用。随着人类社会发展,后来出现了权力制衡等等模型。

这对于我们去界定“AI的边界”,就像人类社会有行为规范、法律法规一样,用一些原则去解决现有的问题,制衡其发展不要失控,也不要被滥用。

比如,在微软对于人工智能的解决方案中就率先提出了,在公司治理中成立道德总监,道德办公室或者道德委员会的组织部门,能够始终保持独立、长远、社会的视角,去观察和监督技术在整个企业中的实践。

而这仅仅是一个方面。要做到这些,我们需要行业头部企业站出来,率先进行反思,全面树立标准,建立AI技术的行动指南。

三、我们需要什么样的未来世界?

数字化的时代,你的每次点击也是一次选择,是对你希望的未来世界的一次投票。

那么,在数字时代,应该是怎样的数字规则?公平正义是基础,隐私是关乎个人安全的基石,权力透明和问责可以规范企业的责任义务,最终才能带来信任包容等等……每个人、每家企业或许都能给出自己如何担当的答案。

在微软提出的方法论框架中,包含了六个关键词:

公平、可靠和安全、隐私和保障、包容、透明、问责。

1. 公平 vs 偏见

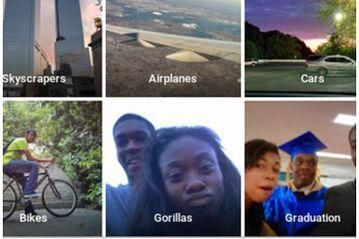

人非圣贤。人类无法做到100%无偏见,很多时候甚至不是有意为之,所以喂养给机器的数据难免也带有偏见。

2015年,大名鼎鼎的谷歌在自家图片应用把两个黑人标记为“Gorillas(大猩猩)”,引起一片哗然。

在谷歌相册推出的同时,雅虎旗下图片分享网站也发布类似图像自动标记功能,也曾将黑人的照片标记为猿猴。

市值已经突破一万亿美元的亚马逊,在2014-2017年使用的AI招聘软件中,被查出会对简历中含有“女性”字样或暗示申请者是女性的简历降级,对男性求职者更加有利。

为什么开放平等的亚马逊,人工智能会出现这样的标准?

究其原因,软件人工智能学习的内容,来源于亚马逊历史10年的简历,而恰恰这10年,亚马逊聘用的男性求职者更多。

所以究其根本,是技术出错,还是人的错?如果AI只是揭示了社会历史上一个众所周知但“不能说的秘密”,那么应该被改变的是AI,还是人类自己呢?

最终,亚马逊发现异常并下架了这款“打脸”人工智能招聘软件。

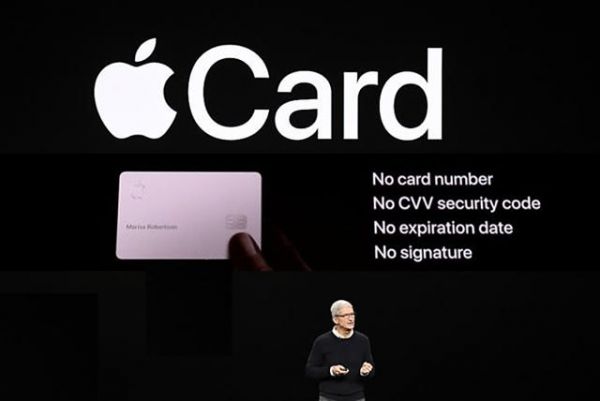

在美国,夫妻是联合报税的,但在最近苹果信用卡的案例中,某男子获得的 Apple Card 信贷额度却是妻子的 20 倍左右。苹果联合创始人史蒂夫·沃兹尼亚克等人也报告了类似的结果。

深陷丑闻后,Apple Card联合发行商高盛银行在Twitter 声明,Apple Card 申请流程,并不会引入性别或其它偏见:“我们从未、且永远不会根据性别等因素做出决定。”目前,华尔街监管机构已经对高盛集团的信用卡业务展开调查。

这就是首先要引入“公平”原则的原因。

如果在企业AI的黑箱中就潜藏不公平,将会造成极为可怕的影响。

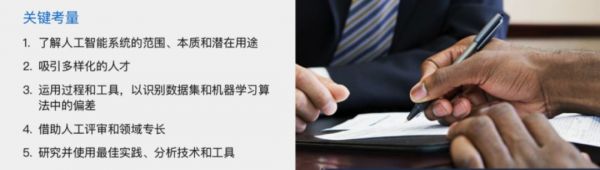

所以, 人工智能系统应该公平对待每一个人,避免对处境相似的人群区别对待。如何做到?微软给出了以下关键考量指标:

用这些多维度的指标,帮助企业评估AI算法是否能在长短期都做到公平,避免像苹果这样的情况,或者能尽早检测出情况。

2. 可靠和安全

很多人不知道,在中国一些看似最传统的企业,都已经武装上了“人工智能”。

“煤矿大脑”在山西、内蒙古、陕西等大量的煤矿应用,让煤矿企业减少矿井作业人员10%,避免安全事故,识别和预警影响连续生产的异常状况,提高煤矿有效工时10%,使年产百万吨的煤矿可增收3000万以上。

像这种对于人身安全、组织协作要求非常之高的产业,如开矿、冶金、制造业工厂等等,无论在正常,还是出现意外时,都需要保障AI(人工智能)能够可靠、安全的运行,不造成更多问题。那么,其考量指标包括:

3.隐私和安全

你有没有这种经历?在一些应用中搜索鞋子之后,各种网站就给你推送鞋子的广告。当在B家咖啡线上购买后,就收到了A家咖啡的打折券?

当AI渗透入每个人日常生活方方面面的时代,我们要怎么保护自己的隐私?企业又应该做什么,来获取大众的信任?微软提出的考量框架如下:

隐私安全的保护不能只依靠企业的自觉。市场监管主体已经在行动。我们常常看到,某些知名APP因私自收集用户个人信息,而被工信部点名整改,否则将被下架。

一些巨头也已经在行动了。2019年因美国质疑其信息安全的华为,就发布了《AI的安全和隐私保护白皮书》,介绍华为对AI安全与隐私问题和解决方案的思考与实践,并提出了AI安全与隐私保护治理责任共担模型。

在大数据时代,信息就是资产,企业、用户、政府都是利益相关方,一方进一寸,就意味着另一方必须退一寸。一切都是博弈的结果,不要忘了自己手中的一票。

4. 包容

据世界残疾报告指出,全球残障人士已超10亿人次,占全球总人口15%。在中国,平均每15人里就有一名残障人士。

对于全球10亿残障人士而言,人工智能技术意味着什么?游戏规则的改变。

譬如,从实时语音到文本转录、视觉识别服务和预测文本功能等智能解决方案,已经在为那些具有听觉、视觉和其他障碍的人们提供支持。AI对于人体的补充延伸,也在创造过去所谓的奇迹。

但与此同时,在电影中常常出现的“赛博格”(机器人类),之所以会带来恐慌,就是技术狂飙突进,没有从社会、伦理、法律等等方面,去进行讨论和限定。所以对于这类医疗器械、辅助器械等等人工智能公司,应该做到什么?

5. 透明

人们往往并非恐惧科技本身,而是恐惧科技带来的未知。就像飞机上的黑匣子,不打开它,就找不到发生空难的真实原因。

AI企业要做到透明,至少需要让人们有权利知道人工智能系统是如何做出决策的,尤其是当这些决策影响到了生活;

有权利知道,APP是否在监视自己的每次点击和行为,会用AI模型对自己的搜索记录,生成用户画像,并向你推送定制化广告。

数据权限的明确定义,决策流程的透明,输出结果的解释,做到这些,用户才可能信任AI,从而信任企业。

6. 问责

当技术快速发展,最让人恐惧的是“失控”。

所以,使用AI技术的权责和义务,不仅需要依赖企业自觉自发的行为,也需要整个产业界的共识,媒体、公众和政府的介入,推动其发展。

人们在近现代社会经济不断发展的过程当中,我们发现人类一直在处理短期利益与长期利益,经济发展与社会责任,寻求这些矛盾之间的平衡。

于是,市场开始要求企业去披露CSR(Corporate Social Responsibility 即企业社会责任)、ESG(Environment, Social Responsibility and Corporate Governance即环境、社会和公司治理 )的行为报告,让公众进行了解和监督,做出消费选择或投资决策。

企业应该负担起的责任,也得到大众、媒体、投资人股东的关注和监督。现在,也需要让让阳光照进来,照进这些可能让人生畏、让人看不懂的科技企业。

听不到任何不同声音的科技发展,才真正让人恐慌。

四、人机共生时代:企业的责任

2020年已经来临,但世界上并没有发生那些科幻电影中出现的可怕画面。

比如,《终结者》中强大得令人发指的机器人,要把人类赶尽杀绝。又或者《银翼杀手》中,人类要消灭机器人。

反而,AI更多是在居家时帮人开灯、放音乐,开车时导航换目的地的“小助手”,变成人的手、眼睛和大脑的延伸。

AI可以成为一面镜子,来帮助人看清技术的发展。

AI是不是可以帮助我们更好地修正自己?更好地想清楚,我们需要什么样的企业?什么样的未来世界?我们希望未来的人类,我们自己的孩子,会活成什么样?

以上的问题,实际上贯穿了我们全文的讨论,同时,也贯穿着微软打造的AI商学院一系列免费在线课程(点击“阅读原文”一键获取免费课程)。

从案例研究、专家讲座视频以及专业见解,给繁忙的CEO、创业者、高管和工程师们,一个成熟的框架,利用碎片时间去了解,与自己公司面临的实际问题结合。

未来已来。微软AI商学院正是从AI行业拓荒者专业经验的角度,给予企业高层一些顶层设计的见解。

最终AI向善,就是人的向善,是企业的向善。只有企业考虑清楚了自己的技术价值观,才能在追求高效、高速发展的路上,不丢失人之为人那些美好的东西。

乔布斯说"Stay hungry,stay foolish"(求知若饥,虚心若愚),成为很多年轻人的座右铭。但在面临拓展人类边界的前沿科技时,我们也要"Stay critical,stay rational"(保持质疑,保持理性)。

相关推荐

人性善恶,决定科技善恶

AI向善之前,人类有勇气先改变自己吗?

被架在火上的腾讯

评论:700万元订单“薅死”网店 羊毛党已成蝗灾

美国AI公司30亿人脸数据被黑,遭科技巨头联合“封杀”

Facebook 审核人员暴增,科技巨头的漫漫审核路

只是在手机里装个输入法App,为什么还要我的位置权限?

这一次,我们更坚信“智慧科技”的未来 —— 高捷季刊:7个项目喜获下轮融资

在手机里装个输入法App,为什么还要我的位置权限?

科技向善其实挺复杂的

网址: 人性善恶,决定科技善恶 http://m.xishuta.com/newsview17697.html