科学家用AI预测下一镜头,为影视剧提供视觉和叙事一致的应用工具

(来源:DeepTech深科技)

多镜头电影级叙事的视频生成来了!

近期,新加坡南洋理工大学与香港中文大学、上海人工智能实验室团队合作,开发了一种名为 Cut2Next 的新框架,提出了“下一个镜头的预测”(NSG,Next Shot Generation)。在层次化多提示策略下进行上下文调优,实现了符合电影级水平、叙事连贯的高质量镜头生成。

Cut2Next 向电影镜头生成领域迈出了重要的一步,通过同时关注视觉一致性和叙事流畅性,确保了引人入胜的故事表达。审稿人对该研究评价称:“该研究创新性地使用 DiT(Diffusion Transformer)和层次化提示策略,使得生成的镜头不仅符合专业剪辑模式,还保持了连续性。用户研究也验证了它在生成高质量、富有叙事表现力并且符合电影标准的镜头上的卓越表现。”

该研究提出了一种基于关键帧和多镜头生成视频的新范式,为多模态的通用人工智能(AGI)提供了视觉信息建模的新思路。Cut2Next 为影视剧、AIGC 短剧和社交媒体领域提供了一种应用级工具,以高效快速地迭代长视频的拍摄方案。此外,其还可用于互动游戏及具身智能领域的仿真内容和仿真数据。

现有视频模型:缺乏视觉和叙事的一致性

随着技术的发展,目前 AI 模型已经能够生成高质量的单镜头视频,不久前发布的 Sora 2 最长可生成 10 秒的视频。然而,从时代和视频应用的实际需求来看,现有视频模型仍缺乏叙事连续性。尽管此前学术界已有长视频生成的相关研究,但仍面临如何平衡主题和叙事一致性以及高质量细节的挑战。

·视觉和叙事的一致性:视觉的一致性,包括角色以及光照、打光、色调等整体风格的一致;叙事的一致性是指,需要捕捉到特定的拍摄镜头、机位、运镜角度等。

·高质量细节:其难题是在保证一致性的前提下,如何尽可能多地生成高质量的细节,这往往与文艺作品或视频美学价值密切相关。

(来源:arXiv)

(来源:arXiv)在文本模型领域,当用语言模型生成长文本时,经常会出现幻觉问题。而在视频模型或文生视频模型领域也面临同样的问题:随着生成故事的篇幅越来越长,模型会慢慢出现漂移,出现一些不存在的、不符合现实世界运作的幻想。

从 AGI 的角度来看,过去五年整个 AI 领域的发展是由大模型驱动的。OpenAI 联合创始人伊尔亚·苏茨克维(Ilya Sutskever)曾提出大模型背后的本质是“压缩即智能”(compressor is intelligence),这种压缩机制也推动了从 GPT-3 到 GPT-5 的发展。

在语言模型中,核心训练任务是“下一个词的预测”(NSP,Next Word Prediction);与该范式类似地,在该研究中,研究人员提出了“下一个镜头的预测”(NSG,Next Shot Generation)。

该论文共同通讯作者、南洋理工大学刘子纬副教授对 DeepTech 解释说道:“如果将视觉看成一种语言,影视剧作品就是一种镜头语言,它是人类智慧的一种高度抽象,比如做某一种叙事、传达某一种情感、前后如何连接到一起,甚至还包括制造戏剧冲突,让 AI 能够达到 AGI 的视觉的涌现程度。”

可实现电影叙事中的编辑模式

对于任何一种多镜头视频,无论是电影还是电视剧,都存在不同层次的关系和连接,并经过从分镜到拍摄再到后期剪辑的制作过程。在真实的片场里,摄影师主要聚焦于整体镜头的布局、分镜头、如何打光以及捕捉角色的动作等。而更高层次的是镜头与镜头之间的连接,这部分取决于导演和剧本。

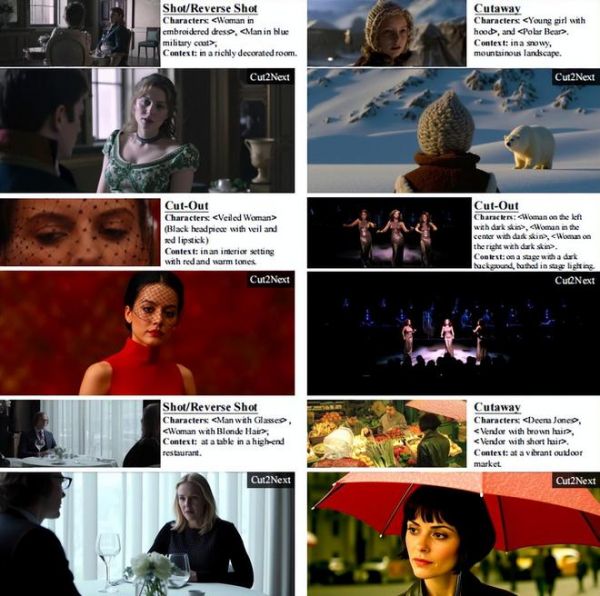

在该研究中,研究人员提出了一种层次化多提示策略,其中包含关系提示(Relational Prompts)和个体提示(Individual Prompts)。可以将它理解为 AI 同时承担了导演和摄影师的角色,能够捕捉不同层次的信息。

该技术的创新性主要体现在上下文感知条件注入(CACI,Context-Aware Condition Injection)和层次化注意力掩码(HAM,Hierarchical Attention Mask),有助于提升镜头的质量以及连贯性。

图丨 Cut2Next 展示其多功能的下一个镜头生成能力(来源:arXiv)

图丨 Cut2Next 展示其多功能的下一个镜头生成能力(来源:arXiv)首先,上下文感知条件注入的目的是让模型在某个电影场景下,更好地感知哪些元素是最重要的,包括从低层次的光照、角色一致性,到更高层次的镜头一致性,甚至需要想象在三维世界中的情绪流动等。

刘子纬指出,可以将上下文感知条件输入看作把视频生成、多镜头生成推向更高阶的能力。基于此,Cut2Next 可实现电影叙事中重要的编辑模式,包括正反打镜头、切出镜头和切出镜头。

其次,层次化的注意力掩码。现在无论是语言模型还是视频模型,都依赖于 Transformer 的注意力机制。但注意力机制相对昂贵:由于计算复杂度呈指数级,因此信息量越大,复杂度越高。

尤其对于视频来说,随着帧数增长,长视频难以有效捕捉。在该研究中通过层次化注意力掩码的形式,降低了计算的复杂度,从而可在不引入新参数的条件下,模拟更多、更长和更丰富的信息。

为影视剧、AIGC 短剧和社交媒体提供应用级工具

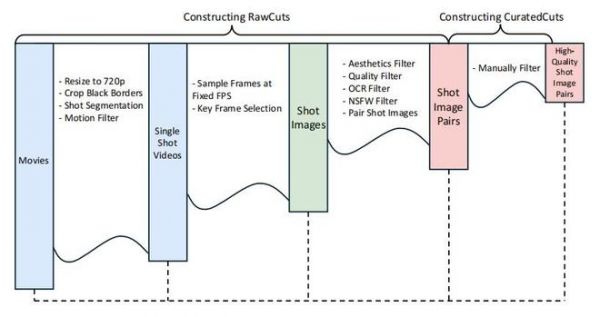

为更好地支撑 Cut2Next 框架的训练,研究团队构建了两个全新的数据集:RawCuts 是针对预训练阶段,旨在提升阅片量的多样性和丰富度的大规模数据集,其涵盖镜头数量超过 20 万对;而 CuratedCuts 则是针对模型的精调或后训练阶段,以提升品位和培养审美的精标注数据集。

图丨RawCuts 和 CuratedCuts 的数据构建管道(来源:arXiv)

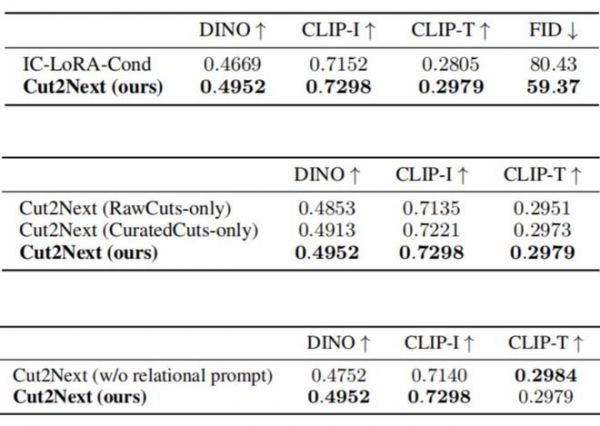

图丨RawCuts 和 CuratedCuts 的数据构建管道(来源:arXiv)研究人员对现有主流文生图模型进行测试,发现它们在视觉一致性上表现并不理想,特别是影视集的生成。实验结果表明,Cut2Next 在视觉一致性、文本保真度和电影连续性等方面均表现出优于现有模型的性能。

“我们的研究相当于填补了领域内的空白。此前这个问题即便依靠工业界的大量数据也没有解决,而它可通过生成 NSG 来解决,甚至有可能用于探索一些新应用和下游拓展。”刘子纬说。

图丨相关性能对比(来源:arXiv)

图丨相关性能对比(来源:arXiv)日前,相关论文以《Cut2Next:通过上下文调整生成下一个镜头》(Cut2Next: Generating Next Shot via In-Context Tuning)为题发表在预印本网站 arXiv[1]。南洋理工大学博士生何静雯是第一作者,南洋理工大学刘子纬副教授和香港中文大学欧阳万里教授担任共同通讯作者。

图丨相关论文(来源:arXiv)

图丨相关论文(来源:arXiv)该技术一方面有望用于影视行业的故事板生成;另一方面,还可能为互动游戏或具身智能领域提供仿真数据。

故事板生成是影视剧,特别是大成本制作电影实拍前的重要步骤之一,甚至需要包括 3D 信息。“目前火爆的 AIGC 短剧每集大概在几分钟,包含约十几个关键帧,也非常适合用这套工具来做纯 2D 的解决方案,而且能快速高效地生成不同风格的内容。”刘子纬表示。

此外,该技术还可充分发挥创意,应用于个人创作者制作出个性化的、用于电商直播或虚拟偶像直播的视频。

另一方面,该技术可应用于生成开放式互动游戏领域的仿真内容和具身智能领域的仿真数据。刘子纬进一步说道:“现阶段大部分机器人的数据相对比较单调,多数采集于实验室或工厂。从更长远的角度来看,Cut2Next 为未来机器人更理解人类的生活甚至情感,提供具身智能的仿真数据。”

图丨刘子纬(来源:刘子纬)

图丨刘子纬(来源:刘子纬)刘子纬在香港中文大学获得博士学位,导师是汤晓鸥教授和王晓刚教授,之后他在美国加州大学伯克利分校从事博士后研究工作,合作导师为 Stella Yu 教授。并且,其还基于一系列优异成果成为 2023 年《麻省理工科技评论》“35 岁以下科技创新 35 人”亚太区入选者之一。

目前,刘子纬团队的主要研究方向是多模态生成式 AI,不仅关注视频与文字的结合,也致力于从不同模态的信息入手,将视频与 3D/4D 信息融合用于增强现实(AR,Augmented Reality)、虚拟现实(VR,Virtual Reality)等场景,实现理解甚至超越世界。

《哥德尔、埃舍尔、巴赫》一书中曾提到,人工智能的发展与人类的各种艺术创作在深层次可能是相通的。刘子纬在从事研究初期颇受该书籍的启发,据他介绍,该研究中还有一个有趣的观察——数据与研究者是密不可分的。起初,他们认为数据集的构建相对客观,但后来他们发现所有的数据集实际上与研究者的价值观或者研究品味紧密相连。例如,在数据构建中,研究人员会挑选多镜头的案例,但其中会涉及到如何去判断哪些多镜头是连续的,哪些多镜头是表达个统一的语义等等。

后来他们发现,当不同领域的研究者看待同一问题时,可能会得出不太一样的结论。因此,如何将结论和标准统一是一个很有趣的问题,这与目前用 AI 解决数学题、写代码等确定性问题有本质的不同。他们在后续的研究中,也将继续深入研究和讨论该问题。

由于该研究涉及 AI、创意、影视制作、人机交互等多个交叉领域,目前研究团队正在邀请一些跨领域的相关学者,共同探索基于 Cut2Next 如何进行创作或更好地辅助相关研究。他们计划进一步开源模型、数据以及前期的发现。

此外,研究人员还打算将该技术向产业界推动,并正在与影视公司、短剧公司接洽,通过了解市场的实际应用需求,进一步精准优化模型的速度和效率等,并通过与业界联合不断迭代下一版。

本次研究中的 Cut2Next 工作相当于连接了语言、视频,甚至是不同层级的多镜头视频。未来,研究团队可能将这项工作继续推进到对世界的终极理解——3D、4D 的层面。

参考资料:

1.https://arxiv.org/abs/2508.08244v2

运营/排版:何晨龙

相关推荐

科学家用AI预测下一镜头,为影视剧提供视觉和叙事一致的应用工具

改变科学的10种计算机工具,你用过哪个?

Facebook 家用摄像头“Portal”:向好莱坞学习

未来科学的进步,将取决于人类还是AI ?

腾讯AI 的新叙事

焦虑症有救了?科学家用“神经反馈”来管理压力

为建筑设计提供通用型AI工具,「小库科技」完成近亿元A轮融资

AI Coding能撑起一个多大的叙事?

AI能“拍”好电影?五部短片亮相釜山电影节,答案出乎意料

预测分析平台「Accern」超募 1300 万美元A轮融资,为金融业提供数据分析工具

网址: 科学家用AI预测下一镜头,为影视剧提供视觉和叙事一致的应用工具 http://m.xishuta.com/newsview142855.html