Meta用“免费版ChatGPT”打响翻身仗,还把微软拉上了船

本文来自微信公众号:APPSO (ID:appsolution),作者:黄智健、陈泽钧,头图来自:Microsoft

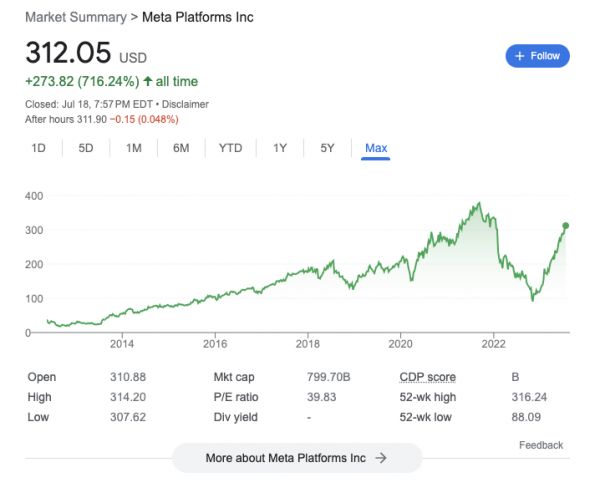

去年的 11 月,Meta 经历了“Alll in Metaverse” 后最难熬的寒冬。

彼时的 Meta 遭遇了苹果调整隐私策略和元宇宙预冷的双重打击,股价一度跌至近 6 年来的谷底,比 2021 年的最高价位缩水了三分之二有多。

但出乎意料的是,Meta 恢复的速度比跌倒还要快。

2023 年 Meta 做出了大量调整,包括裁员和削减项目收缩成本、押注短视频应用 Reels,以及加大 AI 技术的投资,利用 AI 来改进广告模型投放等等。

其中,AI 在 Meta“苏醒”的历程中扮演了非常重要的角色。今年以来 Meta 在 AI 领域持续发力,不断地开源自家的 AI 研究成果,从技术层面来看并不弱于 OpenAI 和 Google 等明星 AI 公司。

就在今天,Meta 发布了开源大模型 Llama 2,引爆了 AI 圈:Llama 2 不仅性能不输 GPT-3,而且免费、开源,还可商用!

什么是 Llama 2?

Llama 2 是 Meta 今年 3 月初发布的 Llama 模型的后续版本,Llama 因为体积小、性能强等优点,在 AI 社区得到了广泛的好评,被认为是推动 AI 研究和开发的重要工具。

Meta AI 今天一同发布了大型语言模型 Llama 2 及其调优版本 Llama 2-Chat,相比 Llama 1,新版Llama 2 在模型规模、训练数据量、模型结构等多个方面进行了全面提升。

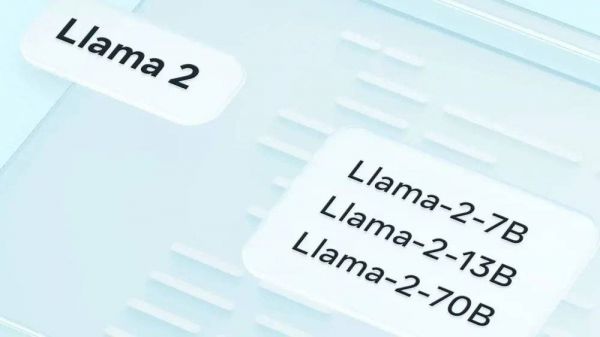

Llama 2 家族包含多个模型规模,包括 70 亿、130 亿、340 亿(暂未发布)和 700 亿参数量的多个版本,覆盖了不同的应用场景需求。

此次Meta首先开源发布了 70 亿和 130 亿参数的 Llama 2 及对应的聊天机器人调优版本 Llama 2-Chat。

与 Llama 1 相比,Llama 2 在三个方面进行了重要的改进:

首先,训练数据量增加了 40%,从 Llama 1 的 1.4 万亿个 token 增至 2 万亿个 token。训练数据中的文本来源更多样化,包括书籍、论文、新闻报道、网页内容等在线公开来源。

Llama 2 还将单条文本的最大长度从 2048 个 token 提升至 4096 个 token,更长的文本输入意味着可以包含更多上下文信息,提升模型的理解能力。

Llama 2 在更大模型的版本中采用了“分组 Attention”机制,可以显著降低计算和内存需求,提升推理速度。

除了规模和结构的改进,Llama 2 在多个自然语言处理基准测试上的结果也优于 Llama 1 和其他开源大模型,显示出在知识表达、推理、对话等能力上的提升。

除了纯预训练模型,调优对话型模型对结果的质量也很重要。

Meta 研究人员开发了全新的调优方案,通过监督微调和强化学习相结合的方式不断提升 Llama 2-Chat 的性能。

举个例子,Llama 2-Chat 的理解能力和表达能力都上了一个台阶,现在可以只用 Emoji 和你聊天,

这是怎么做到的呢?Meta 的研究人员先利用人工标注数据进行监督微调,使模型初步符合人类偏好,兼顾有用性和安全性,为后续的强化学习奠定了良好基础。

然后,利用强化学习中的“拒绝采样”策略进行迭代调优。该策略为每个输入文本生成多个响应,利用训练好的“奖励模型”选择最佳响应,再利用选择后的响应样本微调模型。

研究人员收集了超过 100 万条人类偏好比较数据来训练奖励模型。

在此过程中,安全性和有用性作为两个独立的奖励模型进行训练和评估。

安全性奖励模型可以识别风险更高的输入并给出更低的分数,有助于降低模型生成有害内容的风险。

简单来说,Llama 2 的性能和安全性在开源大模型里面都是首屈一指的存在,更详细的技术细节可以参考 Meta 公布的技术论文。

论文链接:https://ai.meta.com/research/publications/llama-2-open-foundation-and-fine-tuned-chat-models/

目前 Meta 已在 GitHub 上开源了 Llama 2 预训练模型的代码和参数,允许研究人员进行探索。Meta 还开放了 Llama 2 的商业使用许可(但月活量超过 7 亿的产品需要另外申请商用),相信很快将会有一批基于 Llama 2 的大模型产品涌现出来。

模型链接:https://ai.meta.com/resources/models-and-libraries/llama/

Meta + Microsoft = M&M's ?

在今天的微软 Inspire 合作伙伴大会上,微软 CEO 萨蒂亚·纳德拉 (Satya Nadella)还宣布了 Meta 与微软合作的消息,这项合作让 Llama 2 可以运行在微软的云服务 Microsoft Azure。

Meta 则表示,微软是 Llama 2 的首选合作伙伴,未来两者会通过深度合作,以增加对基础人工智能技术的普及,从而让全球的企业受益。

▲部分合作伙伴

而除微软以外,Meta 同时还和亚马逊 AWS、Hugging Face 两家云服务供应商达成合作,在他们的平台上托管 Llama 2 的运行。

值得一提的是,尽管 Meta 宣称 Llama 2 模型是开源且免费商用的大语言模型,但通过 Azure 等云服务方式使用 Llama 2 是否需要收取费用则尚未清楚。

供应商之一的亚马逊发言人告诉彭博社,Amazon 不会收取访问该模型的费用,但客户需要为使用开发工具包支付费用。Meta 对此还没做出回应。

在微软官方博客中,微软表示 Llama 2 已经针对 Windows 进行优化,使其可以在 Windows 本地运行。

这一举措,有可能会让 Windows 一举成为开发者打造个性化 AI 体验需求的最佳平台,同时让 AI 能够用于 Linux 的 Windows 子系统(WSL)、Windows 终端、Microsoft Visual Studio 和 VS Code 等平台上。

也就是说,Meta 推出的 Llama 2 大语言模型可能会成为 OpenAI 的主要竞争者。

但同一时间,微软持有 OpenAI 49% 的股份,OpenAI 也依赖 Azure 来提供大量算力以支撑其人工智能模型的运营,甚至 ChatGPT 目前联网搜索的插件也是接入必应的搜索引擎。

此前让不温不火的必应访问量暴增的 New Bing 也是依靠 GPT-4 技术来开发。可以说,微软在人工智能领域与 OpenAI 已经有深入的合作。

也有评论认为,两者或许存在竞争关系,但不影响微软两边同时押注。闭源领域依靠 OpenAI 实现 2C 业务,进行商业化。开源领域与 Meta 合作,建立生态的同时还能威胁到其他的闭源大语言模型。

Meta 生成式人工智能团队副总裁艾哈迈德·阿尔·达勒(Ahmad Al Dahle)表示,微软与 OpenAI 的合作与 Meta 没有关系。

Meta 与微软更进一步的合作并不让人意外。在 Meta 去年专注于开发“元宇宙”时,Meta 就曾与微软携手把 Office 、Microsoft Teams 等效率工具兼容到 Quest 设备中。

微软同时押注 Meta 和 OpenAI,或许是想要同时在开源和闭源领域广撒网,不错过每一种可能性。

Meta Llama 2 也探讨了在移动终端,特别是智能手机领域,本地运营的可能性。

高通在一份新闻稿中表示,高通正在和 Meta 合作优化 Meta Llama 2 大语言模型直接在终端侧的执行。

高通计划在 2024 年起,在搭载骁龙平台的旗舰智能手机和 PC 上支持基于 Llama 2 的 AI 部署,赋能开发者使用骁龙平台的 AI 能力。

未来 Llama 2 将可能搭载在 VR 头显、汽车座舱、物联网终端等领域。高通认为,终端侧的 AI 部署能显著降低开发成本,提升用户隐私保护、满足用户的安全偏好,增强应用可靠性以及实现个性化的服务。

也许到明年的这个时候,你正在用着的骁龙芯片手机正在运行 Llama 2 模型为你解决问题也说不定呢。

本文来自微信公众号:APPSO (ID:appsolution),作者:黄智健、陈泽钧

相关推荐

Meta用“免费版ChatGPT”打响翻身仗,还把微软拉上了船

昨夜微软正式发布“ChatGPT版Bing”,打响新一轮AI之战

没赶上AI大潮的Meta,点错科技树了?

颠覆历史!微软发布全新ChatGPT版搜索引擎,打响与谷歌的 AI 大战|钛媒体焦点

有了ChatGPT 微软对元宇宙不香了?

砸下677亿,微软盯上ChatGPT|钛媒体深度

微软计划推出私有版ChatGPT,价格贵10倍

挟ChatGPT之威,微软要“二选一”

百度这回能打「翻身仗」吗?

押宝ChatGPT,微软“笑到最后”

网址: Meta用“免费版ChatGPT”打响翻身仗,还把微软拉上了船 http://m.xishuta.com/newsview83574.html