人工智能无法精准读取人脸表情(上)

神译局是36氪旗下编译团队,关注科技、商业、职场、生活等领域,重点介绍国外的新技术、新观点、新风向。

编者按:人工智能读取人脸表情,似乎是众多科技公司都在尝试的新业态。这一市场也在不断增长。一些人认为,情绪检测自动化系统,不仅能更好地发现人类真实情绪,而且还能协调人们内心的感受。但也有许多人担心,这项技术存在很多缺陷,其应用过程甚至会导致新的风险。这篇文章来自编译,作者认为,人工智能根本无法精准读取人脸表情。这是文章的上篇,主要介绍的是情绪识别如何成为人工智能行业中必不可缺的一部分的。

图片来源:oquetemnanossaestante

1967年,一位名叫保罗·埃克曼(Paul Ekman)的美国青年心理学家带着一套抽认卡和一个全新的理论,来到了太平洋西南部国家巴布亚新几内亚(Papua New Guinea)山区高地的一个边远村落。

埃克曼曾听说,东部高地省奥卡普区(Okapa)的法雷人(Fore)几乎与世隔绝。因此,他认为他们应该是理想的被试对象。

和在他之前来到当地的西方研究人员一样,埃克曼来到巴布亚新几内亚,也是为了从当地土著群体获取有关研究数据。当时,他正在收集证据,以证明一个尚存争议的假设:全人类都会展现出一少部分共通的情感或情绪,并且这都是与生俱来的,世界各地的人都是如此。

过去半个多世纪以来,这项论断一直争议不断,引发了心理学家、人类学家以及技术专家的争辩。尽管如此,它还是成为了一颗“种子”,培养出一个不断增长的市场。据估计,到2024年,该市场的价值估计将达到560亿美元。

这篇文章,主要讲述了情绪识别是如何成为人工智能行业的一部分,以及由此产生的问题。

当埃克曼来到属于热带地区的奥卡普区时,他展开了多项测试,来评估法雷人是如何识别情感的。由于法雷人与西方和大众媒体的接触都很少,埃克曼推论出,他们对于核心情绪的识别与表现,可以证明全人类的情绪表达方式都是一样的。

埃克曼的实验方法很简单。他在法雷人面前展示各种面部表情的抽认卡,看他们是否能像自己一样描述情绪。用埃克曼自己的话来说:“我所做的,只是给他们展示有趣的图片。”

然而,在展开实验之前,埃克曼并未了解或认识过有关法雷人的历史、语言、文化或政治背景。他试图通过翻译人员来完成这项抽认卡实验,但却以失败告终。埃克曼和被试对象都被实验过程搞得心力交瘁,用他自己的话来说,就像是拔牙一样。

在首次针对情绪表达展开的跨文化实验研究碰壁后,埃克曼带着沮丧的心情,离开了巴布亚新几内亚。不过,这仅仅是故事的开始。

图片来源:Delta

如今,情感识别工具被广泛运用于国家安全系统、机场、教育领域和创业公司的招聘环节中,也被运用在检测精神疾病的软件和预测暴力行为的执法项目。

然而,据2020年发表于《自然》(Nature)杂志的一篇研究,通过分析一个人的面部表情来精准评估其内心状态的说法,并没有可靠证据。

2019年,心理学家、神经学家丽莎·费尔德曼·巴雷特(Lisa Feldman Barrett)领导研究团队,针对从面部表情推断情感的科学文献展开了系统回顾,结果发现,没有可靠证据表明能以这种方式精准预测一个人的情绪状态。

“我们不可能胸有成竹地从微笑中推断出快乐,从怒视中推断出愤怒,或者从皱眉中推断出悲伤,而目前大多数情感识别技术,都在依赖于这些被误认为是科学事实的推断。”该研究总结道。

那么,在人工智能领域,为什么普遍会接受通过一少部分共通情绪来轻易地解读面部表情的做法呢?

要理解这一点,就需要了解这些想法发展背后的复杂历史和动机,这就要追溯到人工智能情感检测工具研发并运用于日常生活之前的日子。

情感识别自动化的想法令人非常信服,其中也有利可图。科技公司已经捕捉了大量人类面部表情图像,这些图像主要来自于Instagram用户上传的自拍、Pinterest的肖像图片、TikTok的视频,以及摄影图片网站Flickr的照片。

与人脸识别一样的是,无论是大型科技公司还是小型初创企业,情感识别技术已经成为许多平台核心基础设施的一部分。

人脸识别试图识别的是某个特定个体,而情感识别旨在通过分析任意一张人脸来检测情绪,并将其归类于某种情绪类别。尽管缺乏实质性的科学证据来证明其有效性,这些系统如今却已经在影响人们的行为和社会机构的运作方式。

情感检测自动化系统现在已经在多个领域里广泛运用,尤其是在招聘领域。人工智能招聘公司HireVue,就在利用机器学习来推断求职者是否适合某份工作。其主要的客户包括高盛集团(Goldman Sachs)、英特尔(Intel),以及联合利华(Unilever)。

2014年,该公司正式推出了人工智能系统。这套系统可以直接从视频面试中抓取求职者的微表情、语调和其他变量因素。招聘公司可以利用这些信息,横向对比公司内部高效能人士的有关表现。

在遭到学界人士和民权组织的强烈批评后,该公司今年开始不再抓取并分析求职者的面部表情,但仍保留了通过抓取语调这一信息来作为评估标准。

2016年1月,苹果收购了人工智能初创公司Emotient。该公司声称已经开发出一款软件,能够通过人脸图像来识别各种情绪。

就人工智能初创公司而言,规模最大的可能是Affectiva公司。这家公司总部位于美国波士顿,从美国麻省理工学院媒体实验室(MIT Media Lab)分拆出来的公司。

Affectiva公司编写了多种与情绪相关的应用程序,这一过程主要采用的是深度学习技术,其中包括检测道路上分心和危险驾驶的驾驶人,以及衡量消费者对广告的情绪反应。

该公司已经建成了所谓的世界上最大的情绪数据库,其中收录了来自87个国家1000多万人的面部表情数据。该数据库还收录了大量手动标记的视频。Affectiva通过位于埃及首都开罗的分公司招募了35名众包工人,要求他们通过观看视频内容和人脸面部表情来标记不同的情绪。

除了初创企业之外,包括亚马逊、微软和IBM等人工智能巨头也在开发有关情感检测系统。

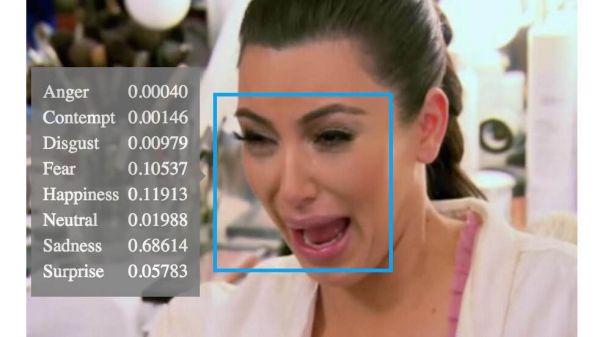

通过人脸API,微软能够提供对感知情绪的检测服务,识别“愤怒、轻蔑、厌恶、恐惧、快乐、悲伤和惊讶”等情绪。

图片来源:thenextweb

亚马逊的图像分析服务Rekognition,也声称可以识别“喜怒忧思悲恐惊”等七种情绪特征,并且可以“衡量这些情绪是如何随着时间推移而变化的”。

这些所谓的情感识别系统,大多都基于一套相似的蓝图和基本假设:全人类都会展现出一少部分显著而共通的情绪类别,我们会不由自主地在脸上流露这些情绪,这些情绪也可以通过机器检测出来。

这些认知在许多领域都被广泛认可。然而,如果我们着眼于如何对情绪分类,或者说如何有序整理并标记这些情绪,我们就可以轻松发现许多潜在的问题。

埃克曼的研究,最初也源自于与著名心理学家西尔万·汤姆金斯(Silvan Tomkins)的一次偶遇。当时,汤姆金斯已经在心理学领域有所建树,他于1962年首次出版了他的代表作《情感、意象、意识》(Affect Imagery Consciousness)。

汤姆金斯在情感方面的研究,对埃克曼产生了巨大的影响。埃克曼在职业生涯中投入了大量时间来研究情感。其中一个思想发挥了特别巨大的作用:如果情感是全人类与生俱来的进化反应,那么它们就应该是共通的,并且在跨文化背景下也是可以识别出来的。

这种对情感共通性的渴望,对这一理论在今天的人工智能情感识别系统中的广泛应用,产生了重要的影响。

在《情感、意象、意识》(Affect Imagery Consciousness)一书的前言部分,作者汤姆金斯将他基于生物学的共通情感理论,描述为应对人类主权严重危机的理论。他对行为主义和精神分析学派的发展提出了挑战,认为这两个学派把意识视为一种单纯的副现象,为其他力量服务。

他指出,人类意识“一次又一次地遭到挑战和削弱”。首先是哥白尼(Copernicus),他称人类并不是宇宙的中心。随后是达尔文(Darwin),他提出了进化论观点,打破了千百年来“上 帝创造万物”的神创论。然后是弗洛伊德(Freud),他提出的动机理论,认为人类意识和推理不是人类动机背后的驱动力。

汤姆金斯在书中写道:“对自然的最大控制和对人性的最小控制的悖论,在某种程度上是因为忽视了意识作为控制机制的作用而导致的。”

简而言之,意识并没有告诉我们为什么我们会有这样的感觉和行为。这一观点,对后来各种情感理论的应用产生了至关重要的作用,后者主要强调的是人类无法识别情感的感受与表达。如果人类自身无法真正检测我们的感受,那么,也许人工智能系统能做到这一点?

汤姆金斯提出的情绪理论,是他用来了解人类动机问题的方法。他认为,动机是由情绪和内驱力两个系统支配的。汤姆金斯提出,内驱力往往与直接生理需求密切相关,比如饥饿和口渴,它们是有助于人类的。因饥饿产生的痛苦,可以用食物来缓解。

然而,真正支配人类动机和行为的主要系统,是包括积极和消极情绪在内的情绪系统。情绪在人类动机中扮演着最重要的角色,它放大了驱动信号,但同时也复杂得多。例如,我们很难知道导致婴儿哭泣的确切原因。

在一个因果关系、刺激物和反应之间的联系如此脆弱和不确定的系统中,我们该如何认识这个系统呢?对此,汤姆金斯提出了一个答案:“主要情感……似乎天生就与一个异常明显的器官系统有着一对一的关联。”这里实际上指的就是脸部。

他在19世纪出版的两本著作中,都找到了关注面部表情的先例。其中,有一本著作是达尔文于1872年撰写的《人与动物的情感表达》(The Expression of the Emotions in Man and Animals)。

汤姆金斯认为,面部表情是全人类的共通特征。他写道:“情绪是面部甚至遍布于全身的肌肉、血管和腺体的综合反应,它可以产生感觉反馈。……这些综合反应可以通过皮层下中枢而触发,而皮层下中枢则储存着不同情感的‘具体程序’。”

但汤姆金斯也承认,对情感表现的理解,也取决于个人、社会和文化等多方面因素。他认为,在不同的社会中,也存在着不同面部语言的“方言”。

考虑到对面部表情的理解,可能在不同文化背景下存在着不同的结果,因此,如果要根据面部表情来训练机器学习系统的话,就不可避免地会将各种不同的背景、信号和期望混在一起。对于埃克曼以及后来的计算机视觉领域而言,问题就在于,到底该如何调和这些矛盾。

图片来源:University of Cambridge/PA

20世纪60年代中期,机会敲开了埃克曼的大门。他获得了来自美国国防部下属研究机构美国国防高级研究计划局(DARPA)的一大笔拨款。这一笔巨额财政支持,为埃克曼首次展开面部表情共通性的研究提供了保障。

总的来说,他的研究遵循了可以复制运用于早期人工智能实验室的设计。在很大程度上,他直接采用了汤姆金斯的方法,甚至还使用了汤姆金斯使用过的图片来测试智利、阿根廷、巴西、美国和日本等国家的被试对象。

在实验中,他向被试对象展示了各种面部表情照片。这些照片也是由实验设计人员精挑细选出来的,每张照片可以突出展现某种特别纯粹的情感,比如恐惧、惊讶、愤怒、快乐、悲伤和厌恶。随后,被试对象被要求根据照片表情选择对应的情感类别,并一一标注。这项实验主要测量的是被试对象选择的标签类别,与设计人员选择的标签类别之间的关联程度。

从一开始,这种实验方法就存在问题。埃克曼要求被试对象从仅有的选择中做出选择的方法,后来引来了批评。这些反对声音称,埃克曼的方法是在提醒被试对象,设计人员已经在面部表情和情绪之间建立起了关联。此外,由于照片中的表情都是刻意摆拍出来的,这一事实也产生了对实验结果有效性的质疑。

一个人的内心状态,可以通过其外部表情符号来精准推断,这一观点由来已久。其部分源于面相学的发展历史。面相学主要是基于一个人的面部特征来研究其性格。古希腊哲学家亚里士多德(Aristotle )认为,“由于人们一直认为肉体和灵魂是有机结合的,因此,可以从人的外貌来判断其性格。”

希腊人早期还把面相当作种族分类的方式,根据人的外貌和特征的不同,把人分成不同的种族(例如埃及人、色雷斯人和斯基泰人)。

延伸阅读:人工智能无法精准读取人脸表情(下)

译者:俊一

相关推荐

人工智能无法精准读取人脸表情(上)

哥伦比亚华人博士推出「蓝脸」机器人,会做42种表情,ICRA 2021已发表

AI“读心术”

谁在贩卖人脸识别的焦虑?

危险的人脸识别

人脸识别十字路口:脸的恐慌

当口罩变成日常,人脸还怎么识别? | 超级观点

如何去掉人脸照片上的马赛克?全靠AI“脑补”

谁在滥用人脸识别?

皮笑肉不笑?读取情绪的AI说:我太难了

网址: 人工智能无法精准读取人脸表情(上) http://m.xishuta.com/newsview53513.html