性能炸裂!Llama 3用开源对抗GPT?

Sora 引发的讨论还在持续。有人认为 Sora 将是通往 AGI(通用人工智能)的快车道,也有人只是认为 Sora 开拓了 Transformer 架构与扩散模型相结合的全新技术路线,还有人认为 Sora 与 AGI 没有太大的关系,是一个产品上的重要里程碑,但在技术上并不比 ChatGPT 更重要。

不管 Sora 的出现意味着什么,大模型之战都还远远未到终局。如果说 OpenAI 已经占据了今天闭源大模型生态的一极,那 Meta 无疑是代表开源大模型的另一极。

Meta 的 Llama(羊驼)可以说从一开始就是最强大的开源大模型之一。去年 7 月,Meta 更是发布更强的 Llama 2,最为关键的是开源协议从「仅研究可用」转向了「免费可商用」,虽然也造就了一大批「套壳」的大模型,但毫无疑问一举改变大模型的格局。

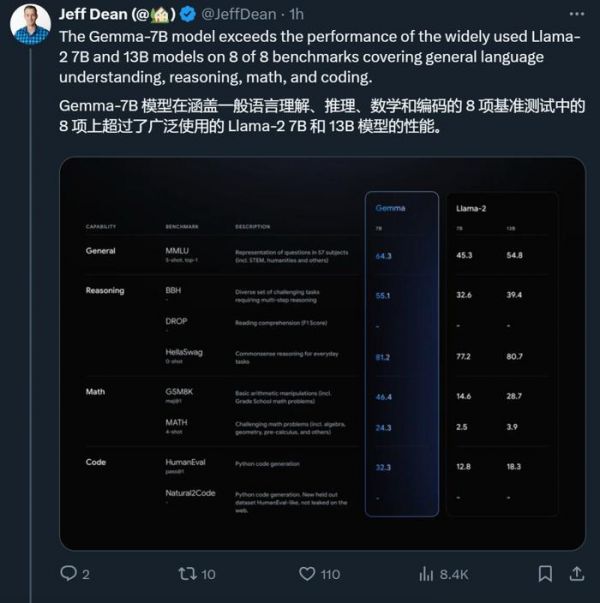

不过 AI 世界一天一变,前有法国开源「新秀」Mistral 将 Llama 2 挑落马下(2 月又推出了「仅次于 GPT-4」的闭源大模型 Mistral Large),后有谷歌发布 Gemma 开源大模型碾压 Llama 2。

Llama 3 该来了。

今年 1 月,Meta CEO 马克·扎克伯格(以下简称「小扎」)就在 Instagram 视频中宣布,Meta AI 已经开始训练 Llama 3。而据 The Information 最新披露,Meta 计划在今年 7 月正式发布 Llama 3。

小扎的官宣视频,图/ Instagram

小扎的官宣视频,图/ Instagram考虑到 Meta 在第一代 Llama 花了三个月的时间来训练,在 Llama 2 花了大约六个月的时间来训练,如果下一代模型遵循类似的时间表,也应该是在 2024 年 7 月的某个时间发布。

不仅如此,综合相关报道以及 Meta 官方透露出的信息,预计将在四个月后发布的 Llama 3 还有着更大的野心,恐怕又将以开源之姿再次改变大模型世界。

Llama 3 继续进化

Meta太豪横了

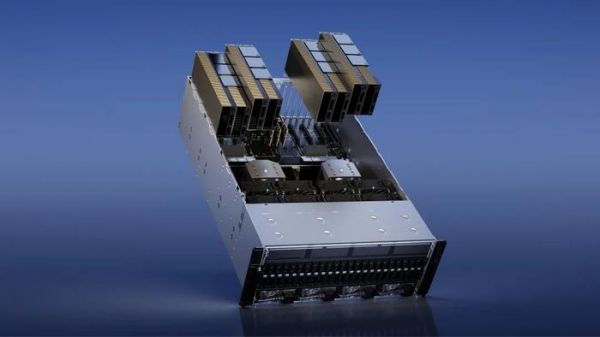

至少在当下,算力依然是大模型「迭代」的关键因素之一,就连 OpenAI 也要时不时说明自身的算力储备。

在 Instagram 视频中,小扎就表示,预计到 2024 年底,Meta 将拥有 350000 块英伟达 H100(官方定价单块 3.5 万美元,实际还在溢价),如果算上其他算力资源将达到近 600000 块 H100:

目前可能也只有微软、谷歌拥有与之可比的算力储备。

H00 GPU,图/英伟达

H00 GPU,图/英伟达小扎的言下之意其实很明显:Meta 有足够的 AI 算力资源来支持 Llama 3 的大规模预训练以及生成式 AI 的技术研究。

具体的参数大小暂且无法得知,但可以预计将会延续之前的多个参数规模版本,有传闻称最大版本将超过 1400 亿参数,直接挑战 GPT-4 等领先的大模型。

The Information 还引用内部消息指出,Llama 3 不仅会放松「安全围栏」,与 GPT-4、Gemini 以及 Llama 2 相比,Llama 3 在处理争议问题时提供更好的回答。Meta 显然希望至少提供有关查询的上下文,而不是忽略、拒绝回答用户提出的问题。

想要做到这一点,除了要求 Llama 3 从技术更好地改善大模型的「幻觉」问题,或许也要求上下文长度的改进。在 Llama 2 上,Meta 就将上下文长度翻了一番,让模型在推理期间(与 AI 聊天的过程)可以「记住」两倍的 Token 上下文。

另一方面,如今大模型厂商普遍都在转向多模态大模型(如 Gemini、GPT-4V)的研究,即在文本之外还支持和理解图像和音频,可以同时生成文字、图片、声音和视频。Meta 大概也不例外。

小扎虽然只确认 Llama 3 和 Llama 2 一样将包含代码生成功能,却没有明确提及其他多模式功能,不过他在官宣视频还是谈到了「人工智能」与「元宇宙」相结合的设想。

「眼镜是让人工智能看你所看、听你所听的理想产品形态,」小扎在谈到 Meta x 雷朋眼镜时指出,「它随时可以提供帮助。」雷科技在独立 AI 终端 AI Pin 的报道中,也深入论述了可穿戴设备在 AI 视觉/听觉领域的巨大潜力。

图/雷科技报道团现场摄制

图/雷科技报道团现场摄制换言之,Meta 的方向一定是让 AI 模型同时具备自然语言理解、视觉和听觉能力。由此推测,Llama 3 甚至后续几代 Llama 对于多模态的支持可以说是题中应有之义。

总得来说,我们可以合理地预期,就算 Llama 3 的规模还是维持在从 70 亿参数到 700 亿参数不等的范围,仍旧会带来显著的性能提升,同时 Llama 3 也将带来更大的想象空间。

更何况 Meta 还有对 AGI 的追求。

「越来越清楚的是,下一代服务需要构建全面的通用智能。」小扎明确地指出了 Meta 构建 AGI 的长期目标,「打造最好的人工智能助手、创作者人工智能、企业人工智能等等——这需要人工智能各个领域的进步,从推理到规划到编码到记忆以及其他认知能力。」

当然,这并不意味着 Llama 3 就将实现(甚至试图实现)AGI。但毫无疑问,Meta 正在有意以一种他们认为最终可能实现 AGI 的方式,进行研究和开发。

为了成功

Llama 3 还会继续开源

公允地说,Llama 3 开不开源,将极大地影响到整个人工智能行业。

作为行业被应用最多的开源大模型,Llama 2 及其为重要核心的上下游已经开始有意识构建生态。去年 12 月,为了对抗 OpenAI、谷歌为代表的闭源阵营,Meta 联合甲骨文、英特尔、AMD、IBM、索尼、戴尔等 57 家全球科技公司和研究机构成立了「AI 联盟」。

AI 联盟成员,图/ IBM

AI 联盟成员,图/ IBM这个联盟有 6 大目标,其中很重要的一项就是搭建开源大模型生态,包括从研究、评估、硬件、安全、公众参与等一整套流程。

小扎虽然从始至终没有明确指出 Llama 3 开源与否,但 Llama 3 很大概率将会继续开源。

官宣正在训练 Llama 3 后,小扎就在 The Verge 的采访中表示:「我倾向于认为,这里面临的更大挑战之一是,如果你构建了真正有价值的东西,那么它最终会变得非常集中。然而,如果你让它更加开放,那么就可以解决由于机会和价值不平等而可能产生的一大类问题。」

如果小扎的回应更像是表达一种态度,Meta 首席人工智能科学家 Yann LeCun 的回应更加「直指根本」。在接受《连线》杂志的采访中,Yann LeCun 指出:

当你拥有一个很多人都可以贡献的开放平台时,进步就会变得更快。您最终获得的系统更加安全且性能更好。(同时)想象一下未来,我们与数字世界的所有交互都由人工智能系统主导。你不希望人工智能系统由美国西海岸的少数公司控制。也许美国人不会关心,也许美国政府不会关心。但我现在告诉你,在欧洲,他们不会喜欢它。

Yann LeCun,图/ Meta

Yann LeCun,图/ Meta总而言之,开源能够吸引更多厂商进行微调,吸引更多的开发者构建应用,也吸引更多的用户进行使用,带动生态的快速进步。特别当 Meta 占据开源大模型的顶级生态位,除了最先进的闭源大模型,用户恐怕会对其他所有模型失去兴趣,Meta 也更容易在 OpenAI 的生态之外培育一个庞大的开发生态,甚至超越 OpenAI:

就如同当年 Android 的后来居上。

此外,监管问题也是无法回避的。考虑到人工智能的颠覆性,当人工智能的进程不是由一家公司完全主导,而是由全球公司和开发者联手打造,也更容易被监管机构所接受。

写在最后

愿景是美好的,现实却不一定。问题是,Meta 还能够重回开源「王座」,甚至超越 GPT-4 吗?

图/ X(原 Twitter)

图/ X(原 Twitter)时移事易,Llama 3 发布之时,Meta 要面对的情况可能完全不同。谷歌 Gemma 的下场碾压,Mistral 的黑马之姿,都证明了 Meta 的开源「王座」并不稳固。尤其是谷歌,虽然次次都被 OpenAI 压一头,但没有人敢真的忽视谷歌的钱、技术与号召力。

当然,这些问题最终还是要等到 Llama 3 发布之时,才会有更明确的答案。在那之前,大模型乾坤未定,一切皆有可能。

发布于:广东

相关推荐

性能炸裂!Llama 3用开源对抗GPT?

Llama 3性能炸裂!Meta要用“开源”争夺大模型王座

聊聊李开复的大模型套壳LLaMA这件事

650亿参数大模型预训练方案开源可商用,LLaMA训练加速38%,来自明星开源项目

开源的Meta,才是整个AI圈的希望?

首次:微软用GPT-4做大模型指令微调,新任务零样本性能再提升

李开复旗下“零一万物”大模型被指抄袭LLaMA

扎克伯格搞免费开源,搅动大模型池水

剑指Llama2,Google开源低配版“Gemini”来了

OpenAI和Meta逼太紧,谷歌被迫开源?

网址: 性能炸裂!Llama 3用开源对抗GPT? http://m.xishuta.com/newsview110598.html